Bestrijden we runderparasieten in de toekomst met onze gewassen?

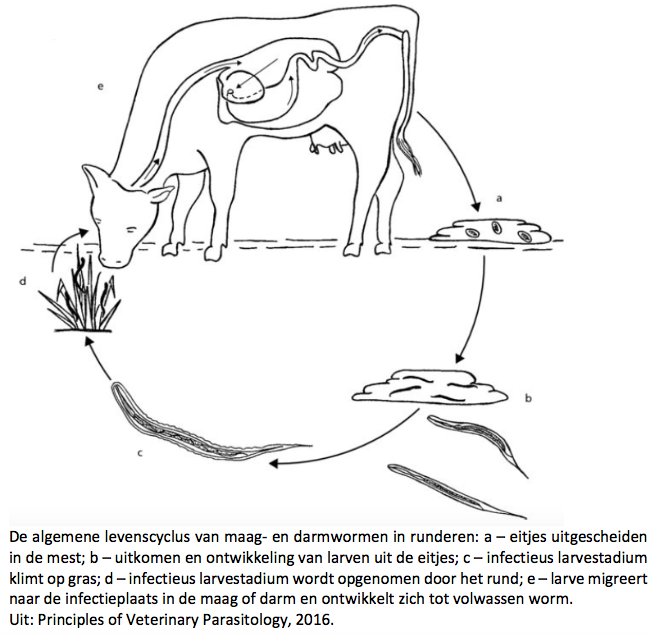

Onze veestapel, specifiek de runderen, worden al vanouds geteisterd door parasitaire infecties. Het is echter pas vrij recent, circa 1940, dat men begonnen is om parasitaire infecties in runderen te bestrijden. Men kwam tot de vaststelling dat deze parasieten schadelijk zijn voor de gezondheid van de dieren waardoor - vooral in deze periode belangrijk geachte - productiviteit van de dieren in het gedrang kwam. Daarnaast hebben zulke infecties natuurlijk een grote impact op het dierenwelzijn vermits ze aanleiding kunnen geven tot ongemak, ziekte en zelfs sterfte. Als we kijken naar de maag- en darmparasieten bij runderen die gehouden worden in westerse landen, dan zien we in de meeste gevallen dat ééncellige parasieten en parasitaire rondwormen verantwoordelijk voor verscheidene ziektes. Zo worden de twee ééncelligen, namelijk Giardia duodenalis en Cryptosporidium parvum, dikwijls verantwoordelijk gehouden voor diarree, groeivertraging, zwakte en sterfte bij jonge kalveren die nog op stal gehouden worden. Daarnaast zijn het juist Ostertagia ostertagi en Cooperia oncophora, de twee belangrijkste parasitaire maag- en darmwormen, die zorgen voor zware infecties bij oudere kalveren en jonge volwassen runderen vanaf dat de dieren op de weide gehouden worden. Het valt dus wel op dat runderen eigenlijk altijd in contact komen met maag- en darmparasieten, ongeacht de kwaliteit en het type van huisvesting.

Om zulke parasitaire infecties te counteren worden onze runderen geregeld, namelijk één- of tweemaal per jaar, behandeld met anti-parasitaire middelen. Normaal gezien, indien op de juiste momenten uitgevoerd, zou dit ervoor moeten zorgen dat ernstige infecties voorkomen worden en dat de dieren eigenlijk weinig parasitair ongemak ondervinden. Echter niet lang na het op de markt brengen van de eerste anti-parasitaire producten, werd al beschreven dat de effectiviteit van de behandeling afnam doordat een deel van de parasieten resistentie-eigenschappen begon te vertonen. De ontwikkeling van resistentie tegen ontwormingsproducten, of anthelmintica, werd oorspronkelijk gedocumenteerd bij schapen in Australië en Nieuw-Zeeland die blootgesteld werden aan de rode lebmaagworm. Deze bloedzuigende maagworm gaf bijgevolg dan ook aanleiding tot ernstige uitbraken van bloedarmoede onder grote populaties van schapen doordat de ontwormingsproducten niet meer hun beoogde effect behaalden. In die periode werden dusdanige problemen bij runderen echter nog niet gerapporteerd, maar recent blijkt dat een steeds groter wordende wormpopulatie resistent begint te worden tegen de huidige anthelmintica, terwijl er in de laatste jaren eigenlijk zeer weinig nieuwe producten op de markt zijn gekomen. Bijgevolg kan het schapen-scenario zich ook bij runderen afspelen als we niet meer in staat zijn om geïnfecteerde dieren effectief te behandelen. Met andere woorden wordt de toepassing van deze ontwormingsproducten, zonder of met onderliggende behandelingsstrategie, steeds controversiëler. Hoewel antibioticaresistentie wereldwijd natuurlijk zeer belangrijk is voor mens en dier, is het essentieel dat we ook beseffen hoe groot de impact van een gevorderde anthelmintica-resistentie zal zijn op de huidige veehouderij.

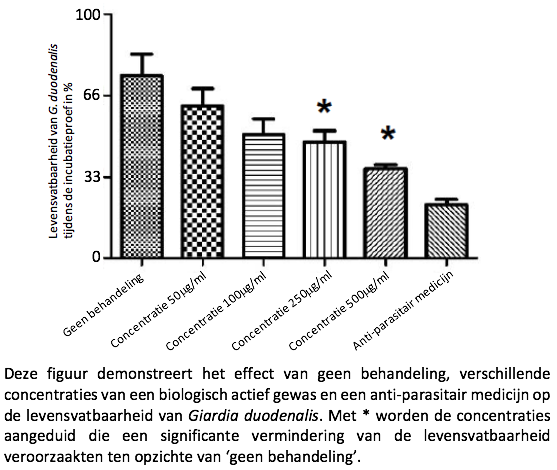

Wereldwijd zijn veterinaire parasitologen bijgevolg hard opzoek naar een mogelijke oplossing tegen de ontwikkelende resistentie, maar tot dusver heeft dit nog niet geleid tot dé oplossing. Enkele potentiële alternatieven die naar voren worden geschoven door vooruitstrevende parasitologen zijn onder andere vaccin-ontwikkeling en het voederen van biologisch actieve gewassen aan veedieren. Daarnaast helpt een meer algemene aanpak, zoals weidemanagement en de selectieve behandeling van enkel zieke dieren wel om de ontwikkeling van resistentie af te remmen, maar dit zal - zeker vanuit economisch oogpunt - gecomplementeerd moeten worden met een ander alternatief om echt effectief te zijn op langer termijn. Met deze huidige problematiek in gedachten is het mijn ambitie om mee te werken aan het vinden van een oplossing voor dit ontwikkelend probleem. Voor mijn scriptie was het daarom de bedoeling dat ik één van de alternatieven, de biologisch actieve gewassen, verder ging onderzoeken. Zo'n onderzoek komt natuurlijk niet uit de lucht vallen en is gebaseerd op bouwstenen die gelegd zijn door voorafgaand onderzoek. Zo hebben onderzoekers al kunnen aantonen dat sommige planten, of plantenextracten, daadwerkelijk een anti-parasitaire eigenschap bezitten. In de meeste gevallen worden tannine-rijke plantendelen, ook aanwezig in bijvoorbeeld wijn en thee, verantwoordelijk gehouden voor dit gunstige effect. Zo is het zeer waarschijnlijk dat deze tannines het eiwit in de darm, afkomstig van de voeding, kunnen binden waardoor de parasitaire wormen hiervan geen gebruik kunnen maken. Tevens heeft recent onderzoek aangetoond dat het voederen van deze biologisch actieve planten aanleiding kan geven tot een afname van het voortplantingsvermogen van de wormen met bijgevolg een lagere infectiegraad. Het is bijgevolg gekend dat er planten zijn met een anti-parasitair effect, maar vooraleer deze effectief toegepast kunnen worden is het onder andere belangrijk dat we weten welk specifiek onderdeel van die plant verantwoordelijk is. Door verschillende internationale bedrijven worden er, in het kader van dit onderzoek, extracten of moleculaire verbindingen opgezuiverd uit de verschillende onderdelen van de beoogde planten en deze kunnen vervolgens gebruikt worden in een resem van testen om hun anti-parasitair effect te beoordelen. Daarnaast weet men eigenlijk niet goed of deze stoffen ook een effect hebben tegen andere runderparasieten, waaronder bijvoorbeeld de ééncellige parasieten. Om dit verder te onderzoeken heb ik met mijn scriptie acht extracten getest op enerzijds de twee belangrijkste maagdarm-parasieten, O. ostertagi en C. oncophora, en anderzijds op de ééncellige parasiet G. duodenalis.

Met dit onderzoek, grotendeels uitgevoerd aan de Universiteit van Kopenhagen, heb ik kunnen aantonen dat de de helft van de geteste extracten zorgt voor een mindere levensvatbaarheid van de G. duodenalis parasiet, iets dat nog niet eerder in de literatuur beschreven werd. Bijgevolg geeft dit een sterke indicatie dat deze biologisch actieve gewassen inzetbaar zijn tegen andere parasieten dan enkel parasitaire maag- en darmwormen en dus een groter toepassingsbereik bezitten. Dit is natuurlijk voordelig op grote schaal, vermits hierdoor de algehele parasitaire infectiedruk verlaagd zou kunnen worden, wat tevens zal resulteren in een verminderd gebruik van ontwormingsproducten met finaal een afname van de resistentie-ontwikkeling. Het is echter nog erg vroeg om te zeggen of we daadwerkelijk gewassen kunnen inzetten om het aantal parasitaire infecties in runderen terug te dringen. Zo zal er toekomstig onderzocht moeten worden of deze gewassen goede nutritionele waarden bezitten, smaakvol geconsumeerd worden door runderen en uiteraard economisch rendabel zijn voor de boer.