Als Chinese hutongs ophouden Chinees te zijn

Afbraak, verval en marginalisering. Daarvan proberen Chinese architecten de hutongs in Beijing te redden. Het doolhof van steegjes, woningen en smalle koertjes in het centrum van de Chinese hoofdstad moet steeds vaker plaats maken voor smakeloze hoogbouwprojecten. De wildgroei van aanbouwsels aan het bestaande weefsel en de verouderde staat van de woningen zijn de drijfveren achter deze stedelijke opruimacties. Deze problematiek kreeg pas nationale en internationale aandacht na de bouw van de Olympische ‘stad’ in Beijing voor de Olympische Spelen van 2008, waar vele hutongs toen het leven lieten. Sindsdien proberen architectenbureaus van binnen en buiten China het tij te keren, alsook hun architecturale stempel te drukken op de bouwpraktijk in Beijing. Als interventies in historisch weefsel, worden zulke projecten vaak gewaardeerd om hun sociale relevantie: de ontwerpen moeten de levensomstandigheden van de plaatselijke bevolking verbeteren en een voorbeeld geven van hoe men op een kwalitatieve manier kan leven. De vraag blijft echter op welke manier deze gerenoveerde hutongs nog ‘Chinees’ zijn en hoe wij als westerlingen deze projecten op een juiste manier kunnen bekijken en beoordelen.

Het lijkt absurd dat architectuur in China moeite heeft om Chinees te zijn. Dit is echter niet verbazend: betonnen woontorens worden neergeplant bij de vleet, met het oog op opbrengst in plaats van op Chinese traditie. Om te achterhalen welke strategieën Chinese architecten gebruiken om deze trend tegen te werken, moeten we er een aantal pilootprojecten uitpikken. Het jonge architectuurbureau ZAO/standardarchitecture bijvoorbeeld heeft reeds een aantal interessante hutong-interventies klaargespeeld. Daarnaast bezigen spelers als Vector Architects en ArchStudio zich ook met renovaties in Beijing’s hutongs. Elk project legt op een andere manier de link tussen hedendaagse en historisch-Chinese architectuur, maar we kunnen enkele grote lijnen onderscheiden.

Materiële overeenkomst

Als eerste is er het project ‘Twisting Courtyard’ van ArchStudio. Als publieke ontmoetingsplaats en woning tegelijk, bestaat het complex uit vier eenkamerhuisjes, geplaatst rond een centrale koer. Meteen vallen de houten latjes voor de ramen en de typische dakvorm op. Hoewel deze Chinese dakvorm ook aanwezig is in het volgende project van ZAO/standardarchitecture, draait het hier meer om Chinees uiterlijk. Door de combinatie van het houten raamwerk voor de ramen – iets dat we vaak zien bij traditionele Chinese gebouwen – en de typisch Chinese dakpannen, lijkt dit project reeds ‘Chinees’. Verder wordt er voor zowel de gevels als de koer gebruik gemaakt van grijze bakstenen. Deze bakstenen zijn kenmerkend voor de hutongs in Beijing. Het is dus vrij duidelijk dat dit project op een heel vormelijke manier ‘Chineesheid’ lijkt uit te stralen.

(Foto’s door Wang Ning en Jin Weiqi

http://archstudio.cn/case/2_0_288/)

Chinese artefactentraditie

In tegenstelling tot het ontwerp van Archstudio, focussen de interventies van architectenbureau’s zoals Wonder Architects op de Chinese traditionele artefactenlogica. Ze proberen zodanig te ontwerpen, dat hun projecten zichtbare connecties hebben met hoe men vroeger in China artefacten maakte.

Een mooi voorbeeld hiervan is het project ‘Co-Living Courtyard’ van ZAO/standardarchitecture. Het ontwerp bestaat uit een gerestaureerd deel, een binnenkoer en een nieuwe ‘wand’ aan de koer, die tevens dient als inkomportaal. Opvallend is echter de wijze waarop dat inkomportaal, dat volledig uit beton bestaat, vormgegeven is. In plaats van een orthogonale figuur, kiest het bureau voor een lichte trapeziumvorm met kleine patio die voorzien is net achter de inkompoort, alsook een spleet tussen het betonvolume en de naburige woning.

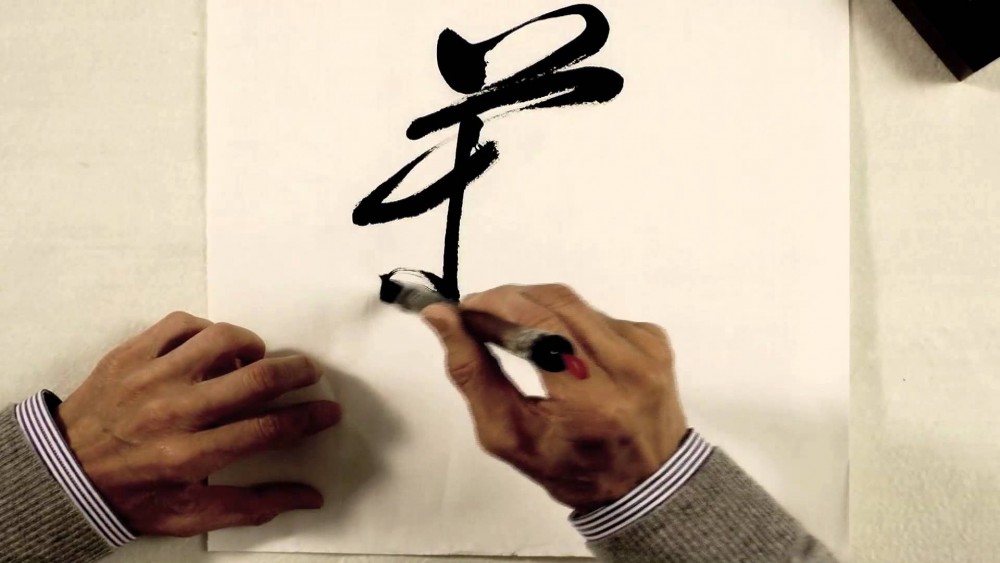

Het resultaat is dat de architecten het belang van leegte benadrukken: waar het beton plaatselijk is weggelaten of teruggetrokken, komt er iets interessants, zoals de kleine patio en de spleet… Het doet denken aan Chinese kalligrafie, waar niet enkel de inktlijnen van belang zijn, maar ook de leegte tussenin. Daarenboven blijven de bewegingen van het penseel, de schrijfsnelheid en de druk die de kalligraaf uitoefent op het penseel, achter in de vorm. De vormelijke eigenschappen zijn dus het product van de manier waarop het karakter geschreven is. Op dezelfde manier kunnen we de vormgeving van het inkomportaal zien als een spannende vorm die zijn dynamisch karakter haalt uit de ruimtelijke spanning tussen voltes en holtes. Het volume lijkt opgespannen tussen het bestaande weefsel, net zoals een karakter spanningen op papier teweegbrengt.

(Foto door ZAO/standardarchitecture.

http://www.standardarchitecture.cn/v2news/7887)

(Foto door Asian Art Museum, https://www.youtube.com/watch?v=643L5qWQmxw)

Verder toont de binnenkoer van het ontwerp – bestaande uit een bassin van kiezels, een centrale boom en ruw afgewerkte beton – gelijkenissen met traditioneel Chinese tuinontwerpen. Traditionele tuinen in China zijn steeds een combinatie van vegetatie, water en rotsen. Water en rotsen lijken te ontbreken, totdat we beseffen dat het beton de rotsen lijkt te vervangen, en de kiezels het water. Het beton heeft eenzelfde ruwe en rigide indruk als de traditionele rotsformaties, terwijl de kiezelbassin doet denken aan een gestileerde versie van een wateroppervlak. Deze relatie met de traditie van Chinese tuinontwerpen komt iets sterker naar voor in de vorm dan de spanning van het inkomportaal, maar het blijft zeker een mooi voorbeeld van hoe men teruggrijpt naar traditionele ambacht en kunst.

(Foto's door ZAO/standardarchitecture. http://www.standardarchitecture.cn/v2news/7887)

Dit soort referenties naar de Chinese artefactentraditie (waaronder dus kalligrafie en tuinbouw), zijn vrij indirect en hoeven niet altijd bedoeld te zijn door de ontwerper. Het geeft ons echter wel een manier om dit project te lezen en te begrijpen en onze indrukken over dit project te benoemen: er is een bepaalde indruk van dynamiek, maar zonder referentie naar kalligrafie blijft die dynamiek toevallig. Onze opmerkingen relateren aan de Chinese artefacten-logica zorgt voor betekenis. Het is dus een waardevolle manier om als westerling naar Chinese architectuur te kijken.

Je ziet dus dat Chinese architecten van alles uit de kast halen om hun architectuur Chinees te houden. Bovendien zijn er, naast deze twee projecten, nog tal van andere projecten die elk op hun manier Chinees proberen te zijn en bijkomende strategieën aan het licht brengen. Sommige geslaagder dan andere. Nu, als Chinese architectuur stopt Chinees te zijn, wat wordt het dan?