Hoe Theologie bijdraagt aan het verantwoord gebruik van Artificiële Intelligentie

De verantwoordelijkheidslacune

Het onderzoek in deze thesis bevindt zich op het raakvlak tussen technologie en theologie, en richt zich op de vraag hoe de mens moet omgaan met de toenemende automatisering die gebruikmaakt van Artificiële Intelligentie (AI). Als onderwerp van dit onderzoek werden zelfrijdende voertuigen (ZRV) genomen. Deze ZRV worden momenteel door tal van fabrikanten getest en zullen weldra op onze wegen verschijnen. Helaas leggen recente ongevallen met verschillende ZRV een belangrijk probleem bloot. Enerzijds is de technologie soms gebrekkig en worden er foute inschattingen gemaakt, anderzijds wordt de indruk gegeven dat de gebruiker van ZRV-technologie niet meer attent hoeft te zijn in het verkeer, en zelfs bijvoorbeeld rustig een dutje kan doen terwijl het voertuig door het verkeer laveert. Door deze tweespalt ontstaat de zogenaamde verantwoordelijkheidslacune (“responsibility gap”). Deze treedt op in situaties waarbij noch de ontwikkelaar van de AI- technologie noch de gebruiker zich verantwoordelijk acht, omdat de gebruiker volledig vertrouwt op AI, terwijl de ontwikkelaars (of de verkoper) van de AI-technologie erop vertrouwen dat de gebruiker wel zal ingrijpen wanneer AI tekort schiet. Dat laatste omdat de gebruiker daartoe contractueel gebonden werd.

Om het ethische dilemma van de verantwoordelijkheidslacune te analyseren, werden in dit onderzoek de standaard ethische benaderingen teleologie (ethiek van doelen) en deontologie (ethiek van normen en plichten), die vaak vanuit een seculiere invalshoek worden toegepast in AI, in dialoog gebracht met de theologische ethiek van de verantwoordelijkheid, zoals ontwikkeld door de theologen Dietrich Bonhoeffer en H. Richard Niebuhr. Uit deze dialoog zijn twee belangrijke bijdragen geleverd op de onderzoeksvraag verweven in de titel van dit artikel.

De mens blijft cruciaal in het ontwerp van de ethische besluitvorming in AI

De eerste bijdrage gaat over het ontwerp van de ethische besluitvorming in AI als autonoom systeem. Standaard ethische benaderingen zijn niet in staat om AI-systemen toerekeningsvatbaar te laten handelen. De oorzaken van dit falen zijn (a) het niet eenduidig oplossen van eenvoudige verkeersdilemma’s, zelfs wanneer alle feiten bekend zijn, en (b) AI- systemen zijn (nog) niet in staat om bij de ethische besluitvorming op gelijke voet in dialoog te gaan met verantwoordelijke mensen. Ze zijn niet in staat om kritiek op hun werking te begrijpen, bezitten niet de mogelijkheid om zich te verdedigen, en kunnen hun acties niet wijzigen op basis van de gegeven kritiek. De eerste bijdrage heeft laten zien dat menselijke tussenkomst in het ontwerp van de ethische besluitvorming van AI-systemen noodzakelijk blijkt. Een nevenliggende bijdrage is dat dit onderzoek de meerwaarde onderschrijft van samenwerking tussen technoloog en ethicus tijdens de ontwikkeling van AI-systemen. Klassiek zal een ethicus pas nieuwe technologische ontwikkelingen kritisch tegen het licht houden, wanneer deze reeds enige tijd op de markt zijn.

Theologie leidt tot een radicale doorbraak

De tweede bijdrage van het onderzoek betrof het verantwoordelijk gebruik van het AI-systeem. In het kader van autonome wapensystemen werd in 2015 door Michael Horowitz van het Amerikaanse Technologie en Nationaal Veiligheidsprogramma de term “Meaningful Human Control” (MHC) geïntroduceerd. Er werd echter niet duidelijk gemaakt hoe de mens op een betekenisvolle manier betrokken kan worden bij het gebruik van autonome systemen. Recent werd door de groep van prof. van de Hoven van de TU Delft een master-slave verantwoordelijkheidsverdelingsmechanisme ontwikkeld om het begrip MHC concreet te maken. Hierbij is het AI-systeem de “master” en de gebruiker de “slave”. Mijn onderzoek heeft aangetoond dat dit mechanisme de verantwoordelijkheidslacune kan verminderen, maar ten koste van de efficiëntie. Dit omdat de regelmatig uitgezonden alarmen door het AI-systeem, om de alertheid van de gebruiker te verifiëren, vaak nodeloos blijken te zijn. Hierdoor treedt alarm-moeheid op, waardoor het AI-systeem de autorit vroegtijdig en vaak nutteloos afbreekt.

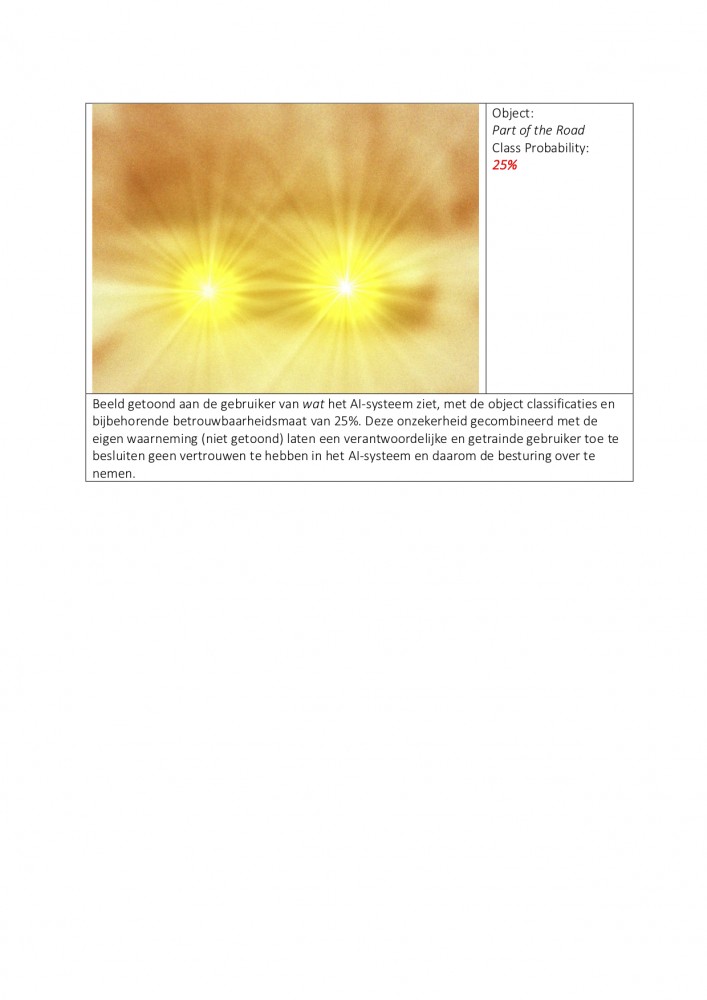

De dialoog met de theologische ethiek van de verantwoordelijkheid, met name het werk “The Responsible Self” van Niebuhr, heeft laten zien dat de mens veel beter in staat is om op een verantwoorde manier met onzekerheid om te gaan dan de standaard ethische benaderingen voor besluitvorming in AI. Deze nieuwe inzichten hebben geleid tot een nieuwe methode waarbij de gebruiker “master” wordt en het AI-systeem “slave”. In deze nieuwe methode is de gebruiker te allen tijde de eindverantwoordelijke. Dit kan als de gebruiker in staat is te interpreteren wat het AI-systeem doet en waarom het dat doet, en op basis van deze informatie een passende actie kan nemen. Bijvoorbeeld om de controle over te nemen wanneer het AI-systeem een wagen op het pad van de ZRV foutief klasseert als een deel van de weg, zie bijgevoegde figuur.

In de thesis is een voorstel gemaakt hoe deze (wat- en waarom-)vragen beantwoord kunnen worden door middel van moderne "head-up" displays waarbij naast de classificatie van objecten ook de betrouwbaarheid van classificatie wordt aangegeven. In hetzelfde voorbeeld zal de gebruiker tot actie overgaan wanneer deze betrouwbaarheid te laag is.

Het gebruik van het nieuwe systeem zal tot meer acties van de gebruiker leiden in vergelijking met het gebruik van AI als “black-box”. Daarnaast zal de gebruiker ook getraind moeten worden om met dit systeem te leren omgaan. Beide facetten zijn niet ongewoon bij het gebruik van automatiseringssystemen, zoals bijvoorbeeld in de besturing van moderne vliegtuigen. Het nieuwe verantwoordelijkheidsverdelingsmechanisme zal niet alleen de verantwoordelijkheidslacune (sterk) verminderen, maar ook de mens meer betekenisvol betrekken bij het gebruik van autonome systemen. Omdat twee paar ogen meer zien dan één paar, zal de veiligheid met het gebruik van ZRV toenemen. Dit onderzoek opent de mogelijkheid om de verwachte voordelen van ZRV, zoals de vermindering van uitstoot, toenemende flexibiliteit van mensen met een handicap, de vermindering van het aantal verkeersslachtoffers, het efficiënter gebruik van de wegcapaciteit, et cetera, te realiseren.

Conclusie

Het advies van dit onderzoek is om de samenwerking tussen technologie en theologie bij het ontwerp van deze AI-systemen aan te gaan vanaf aanvang. Dit zal in de toekomst leiden tot meerdere vernieuwingen.