Is taal de sleutel bij het decoderen van hersengolven?

Brein-Computer Interfaces en Machine Learning

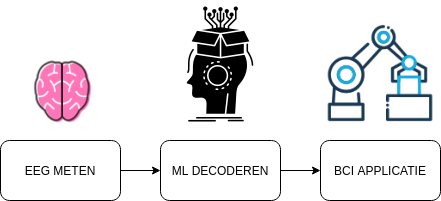

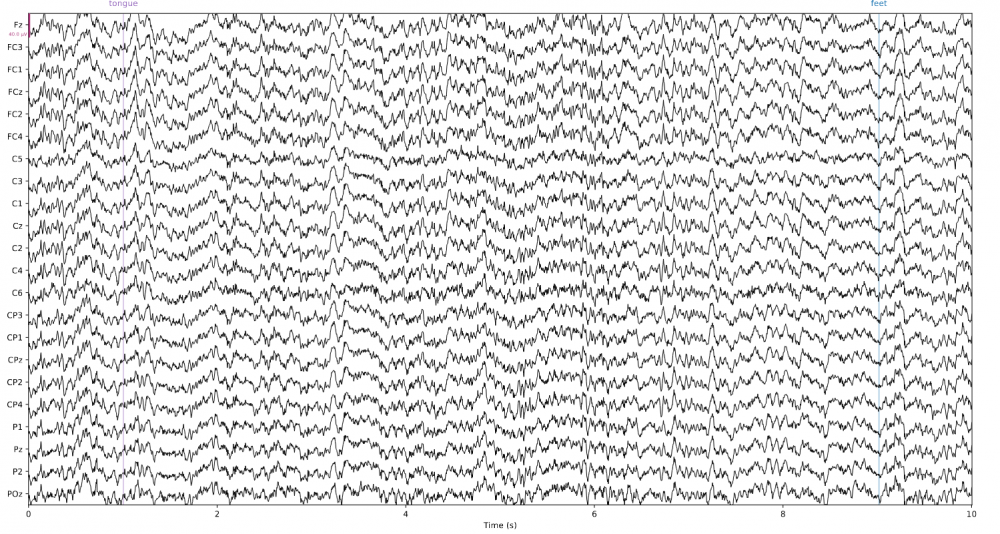

Een Brein-Computer Interface (BCI) is een apparaat dat de digitalisatie van het brein toelaat. De BCI-pijplijn werkt als volgt (zie Figuur 1). Eerst wordt hersenactiviteit gemeten, dit kan aan de hand van een verscheidenheid aan modaliteiten. Elektro-encefalografie (EEG) is daar een van. EEG bestaat uit metingen van de elektrische breinpotentialen op de hoofdhuid (zie Figuur 2). Zo’n metingen kunnen aan de hand van Machine Learning (ML) gedecodeerd worden, wat resulteert in een reeks intenties. Tenslotte worden deze intenties gebruikt om een bepaald apparaat aan te sturen. Recente vooruitgang in onderzoek naar BCI’s heeft klinische toepassingen mogelijk gemaakt, zoals het voorspellen van epileptische aanvallen in een vroeg stadium en breingestuurde protheses, maar ook alledaagse toepassingen zoals intentieherkenning voor smart-living en voertuig- en robotbesturing. Afgezien enkele zeer specifieke gevallen liggen efficiënte en betrouwbare BCI's echter nog ver weg. De ML-methoden die BCI's toepassen om hersenactiviteit te interpreteren moeten nog tal van uitdagingen overwinnen. Data schaarste en variatie in hersenactiviteit, zowel tussen personen als bij een enkele persoon, maken het ontwerpen van BCI’s een complexe zaak. Soortgelijke problemen zijn onderzocht in andere onderzoeksgebieden, waarbij oplossingen zijn gevonden die als inspiratie kunnen dienen voor nieuwe ML-methoden voor BCI’s. Dit onderzoek gaat nog een stap verder. Hier wordt niet enkel gebruikt gemaakt van een ML-model uit een ander domein maar ook van wat dat model reeds geleerd heeft in dat domein.

Figuur 1: BCI-pijplijn.

Figuur 2: De eerste 10 seconden van een voorbeeld EEG-opname. De horizontale as toont de tijd in seconden, de verticale as toont de EEG-electroden. Intenties worden aangeduid in gekleurde verticale lijnen.

Kennisoverdracht

Het decoderen van hersenactiviteit wordt gekenmerkt door een cruciaal probleem: metingen van hersenactiviteit kunnen aanzienlijk verschillen, tussen personen en zelfs voor dezelfde persoon. Om nauwkeurige BCI's te ontwerpen moeten ML-methoden worden gevonden die algemene patronen kunnen leren die op elke persoon van toepassing zijn. Dit aspect van kennisoverdracht heeft in BCI’s altijd al de vorm aangenomen van een ML-model dat eerst leert uit metingen van een aantal personen of verschillende metingen van een bepaald persoon en vervolgens verder leert op de metingen van de persoon die de BCI zal gebruiken. In sommige gevallen leren ML modellen eerst uit data van een geheel verschillend domein. Een recent voorbeeld is een ML model dat eerst leert om foto’s te classificeren aan de hand van een gigantische foto database. Door metingen van hersenactiviteit als foto’s voor te stellen kan zo’n model vervolgens verder leren hersenactiviteit te classificeren, wat resulteert in een relatief accuraat BCI-model. De toegevoegde waarde van deze manier van werken is dat schaarste van data een kleiner probleem is in het domein van foto’s. Met dit in het achterhoofd werkt dit onderzoek aan een gelijkaardige methode maar in plaats van foto’s wordt taal gebruikt. Een samenwerking tussen Facebook en Google resulteerde onlangs in een publicatie waarin beweerd wordt dat enorme taalmodellen die getraind worden op enorme taal databases gezien kunnen worden als algemene computationele modellen. Een aantal evaluaties van een gekend taalmodel in een aantal domeinen niet gerelateerd aan taal toonden dat dit taalmodel, zonder iets van deze domeinen geleerd te hebben, relatief goed presteert. Dit wil zeggen dat er hoogstwaarschijnlijk patronen te vinden zijn in taal die algemeen toepasbaar zijn in domeinen verschillend van taal. In dit onderzoek wordt nagegaan of dit geldt voor EEG.

Taalmodellen voor het decoderen van EEG

Expliciet leest de onderzoeksvraag van dit onderzoek als volgt: “Hoe en in welke mate kan een op taal getraind ML-model overgaan op de classificatie van EEG en beïnvloedt de taaltraining de prestaties?” OpenAI’s GPT2 wordt in verschillende configuraties geëvalueerd op het classificeren van EEG. Een bestaande publieke motor imagery dataset wordt gebruikt. Motor imagery houdt in dat EEG opnames gemaakt worden van een persoon die zich inbeeldt bepaalde bewegingen uit te voeren. De taak van het ML model is om deze bewegingen uit de EEG-metingen te extraheren. Hoewel de finale performantie van GPT2 voor het classificeren van EEG de state-of-the-art niet verbetert, maakt een interessante observatie verder onderzoek de moeite waard. Er wordt namelijk waargenomen dat er een positief statistisch significant verschil is tussen de performantie van GPT2 als het voorgetraind is met taal ten opzichte van wanneer het dat niet is. Dit suggereert dat GPT2 uit de gigantische taaldatabase algemene patronen heeft geleerd die ook toepasbaar zijn in het domein van EEG. Aangezien zulke patronen momenteel relatief ongekend zijn introduceert dit onderzoek dus een nieuwe onderzoeksrichting. Met name, onderzoek dat modellen uit andere domeinen analyseert om zo algemene EEG-patronen te vinden. Daarbij versterkt dit onderzoek ook de claim van de wetenschappers bij Facebook en Google dat deze grote taalmodellen gezien kunnen worden als modellen die verder gaan dan taal en eerder doen aan algemene computatie.

Verder onderzoek

De eerstvolgende stap na dit onderzoek houdt in te gaan kijken of betere performantie verkregen kan worden door gebruik te maken van grotere datasets. Door de grootte en complexiteit van GPT2 is het altijd een mogelijkheid dat het teveel details in de EEG-opnames bekijkt. Het doel van ML is niet op de details te focussen maar de algemene trends te vinden. Door meer data ter beschikking te stellen kan het model geforceerd worden om te gaan veralgemenen en zo algemenere patronen te vinden. Tegelijkertijd kunnen ook de gevonden patronen geanalyseerd worden om zo inspiratie te vinden voor nieuwe BCI-modellen. Deze kunnen op hun beurt BCI’s en het leven van de mens verbeteren.

Projectdetails

De code die geschreven werd voor dit onderzoek is te vinden op GitHub (https://github.com/wulfdewolf/lpt-for-eeg). Een samenvatting van de resultaten van dit onderzoek is te vinden op Weights&Biases (https://wandb.ai/wulfdewolf/lpt-for-eeg/reports/Transfer-Learning-in-Br…). De infrastructuur en dienstverlening gebruikt in dit onderzoek werd voorzien door het VSC (Vlaams Supercomputer Centrum), gefinancierd door het FWO en de Vlaamse overheid.

Bibliografie

Related Synchronization. Oxford University Press.

Pfurtscheller, G., & Lopes da Silva, F. H. (1999, November). Event-related EEG/MEG syn-

chronization and desynchronization: Basic principles. Clinical Neurophysiology: Official

Journal of the International Federation of Clinical Neurophysiology, 110 (11), 1842–1857.

doi: 10/ffwmrh

Pfurtscheller, G., Neuper, C., Muller, G., Obermaier, B., Krausz, G., Schl ̈ogl, A., . . . Schrank,

C. (2003, July). Graz-BCI: State of the art and clinical applications. IEEE transactions

on neural systems and rehabilitation engineering : a publication of the IEEE Engineering

in Medicine and Biology Society, 11 , 177–80. doi: 10/dpn8fh

Pratt, L. Y. (1992). Discriminability-Based Transfer between Neural Networks. In Advances in

Neural Information Processing Systems (Vol. 5). Morgan-Kaufmann.

Pratt, L. Y., & Jennings, B. (1996). A survey of transfer between connectionist networks.

Connection Science, 8 (2), 163–184. doi: 10.1080/095400996116866

Pratt, L. Y., Mostow, J., & Kamm, C. A. (1991, July). Direct transfer of learned informa-

tion among neural networks. In Proceedings of the ninth National conference on Artificial

intelligence - Volume 2 (pp. 584–589). Anaheim, California: AAAI Press.

Qiu, X., Sun, T., Xu, Y., Shao, Y., Dai, N., & Huang, X. (2020). Pre-trained Models for Natural

Language Processing: A Survey. ArXiv . doi: 10.1007/s11431-020-1647-3

Radford, A., & Narasimhan, K. (2018). Improving Language Understanding by Generative

Pre-Training. OpenAI .

Radford, A., Wu, J., Child, R., Luan, D., Amodei, D., & Sutskever, I. (2019). Language Models

are Unsupervised Multitask Learners. OpenAI .

Raducanu, B. C., Yazicioglu, R. F., Lopez, C. M., Ballini, M., Putzeys, J., Wang, S., . . . Mitra,

S. (2017, October). Time Multiplexed Active Neural Probe with 1356 Parallel Recording

Sites. Sensors (Basel, Switzerland), 17 (10), E2388. doi: 10.3390/s17102388

Raffel, C., Shazeer, N., Roberts, A., Lee, K., Narang, S., Matena, M., . . . Liu, P. J. (2020).

Exploring the Limits of Transfer Learning with a Unified Text-to-Text Transformer. Journal

of Machine Learning Research, 21 (140), 1–67.

Raghu, M., Zhang, C., Kleinberg, J., & Bengio, S. (2019). Transfusion: Understanding transfer

learning for medical imaging. In H. Wallach, H. Larochelle, A. Beygelzimer, F. dAlch ́e-Buc,

E. Fox, & R. Garnett (Eds.), Advances in neural information processing systems (Vol. 32).

Curran Associates, Inc.

Raghu, S., Sriraam, N., Temel, Y., Rao, S. V., & Kubben, P. L. (2020). EEG based multi-class

seizure type classification using convolutional neural network and transfer learning. Neural

Networks, 124 , 202–212. doi: 10.1016/j.neunet.2020.01.017

Raina, R., Battle, A., Lee, H., Packer, B., & Ng, A. Y. (2007, June). Self-taught learning:

Transfer learning from unlabeled data. In Proceedings of the 24th international conference

on Machine learning (pp. 759–766). New York, NY, USA: Association for Computing

Machinery. doi: 10.1145/1273496.1273592

Rakotomamonjy, A., Guigue, V., Mallet, G., & Alvarado, V. (2005). Ensemble of SVMs for

Improving Brain Computer Interface P300 Speller Performances. In W. Duch, J. Kacprzyk,

E. Oja, & S. Zadro ̇zny (Eds.), Artificial Neural Networks: Biological Inspirations – ICANN

802005 (pp. 45–50). Berlin, Heidelberg: Springer. doi: 10/bx78jr

Ramadan, R., & Vasilakos, A. (2017). Brain computer interface: Control signals review. Neu-

rocomputing. doi: 10.1016/j.neucom.2016.10.024

Ramos-Murguialday, A., Broetz, D., Rea, M., L ̈aer, L., Yilmaz, ̈O., Brasil, F., . . . Birbaumer,

N. (2013). Brain–machine interface in chronic stroke rehabilitation: A controlled study.

Annals of neurology. doi: 10.1002/ana.23879

Ranzato, M., Poultney, C., Chopra, S., & Cun, Y. (2006). Efficient learning of sparse repre-

sentations with an energy-based model. In B. Sch ̈olkopf, J. Platt, & T. Hoffman (Eds.),

Advances in neural information processing systems (Vol. 19). MIT Press.

Rao, R., Bhattacharya, N., Thomas, N., Duan, Y., Chen, X., Canny, J., . . . Song, Y. S. (2019,

December). Evaluating Protein Transfer Learning with TAPE. Advances in neural infor-

mation processing systems, 32 , 9689–9701.

Rashid, M., Sulaiman, N., P. P. Abdul Majeed, A., Musa, R. M., Ab. Nasir, A. F., Bari, B. S.,

& Khatun, S. (2020). Current Status, Challenges, and Possible Solutions of EEG-Based

Brain-Computer Interface: A Comprehensive Review. Frontiers in Neurorobotics, 14 , 25.

doi: 10/gj326h

Rebuffi, S.-A., Bilen, H., & Vedaldi, A. (2017). Learning multiple visual domains with residual

adapters. In I. Guyon et al. (Eds.), Advances in neural information processing systems

(Vol. 30). Curran Associates, Inc.

Redrovan, D. V., & Kim, D. (2018, March). Hand gestures recognition using machine learning

for control of multiple quadrotors. In 2018 IEEE Sensors Applications Symposium (SAS)

(pp. 1–6). doi: 10.1109/SAS.2018.8336782

Rivest, F., & Kohar, R. (2020, January). A New Timing Error Cost Function for Binary Time

Series Prediction. IEEE transactions on neural networks and learning systems, 31 (1),

174–185. doi: 10.1109/TNNLS.2019.2900046

Robbins, H., & Monro, S. (1951). A Stochastic Approximation Method. The Annals of Mathe-

matical Statistics, 22 (3), 400–407.

Roy, Y., Banville, H., Albuquerque, I., Gramfort, A., Falk, T. H., & Faubert, J. (2019, August).

Deep learning-based electroencephalography analysis: A systematic review. Journal of

Neural Engineering, 16 (5), 051001. doi: 10/ggc76t

Sameer, M., Gupta, A., Chakraborty, C., & Gupta, B. (2020). ROC Analysis for detection of

Epileptical Seizures using Haralick features of Gamma band. 2020 National Conference on

Communications (NCC). doi: 10/gnhcv2

Sankaranarayanan, S., Jain, A., Chellappa, R., & Lim, S. N. (2018, April). Regularizing Deep

Networks Using Efficient Layerwise Adversarial Training. Proceedings of the AAAI Con-

ference on Artificial Intelligence, 32 (1).

Sannelli, C., Vidaurre, C., M ̈uller, K.-R., & Blankertz, B. (2019, January). A large scale screening

study with a SMR-based BCI: Categorization of BCI users and differences in their SMR

activity. PLOS ONE , 14 (1), e0207351. doi: 10.1371/journal.pone.0207351

Saxe, A. M., McClelland, J. L., & Ganguli, S. (2014). Exact solutions to the nonlinear dynamics of

learning in deep linear neural networks. In Y. Bengio & Y. LeCun (Eds.), 2nd international

conference on learning representations, ICLR 2014, banff, AB, canada, april 14-16, 2014,

81conference track proceedings.

Saxena, S., & Cunningham, J. P. (2019, April). Towards the neural population doctrine. Current

Opinion in Neurobiology, 55 , 103–111. doi: 10.1016/j.conb.2019.02.002

Schalk, G., McFarland, D. J., Hinterberger, T., Birbaumer, N., & Wolpaw, J. R. (2004, June).

BCI2000: A general-purpose brain-computer interface (BCI) system. IEEE transactions

on bio-medical engineering, 51 (6), 1034–1043. doi: 10.1109/TBME.2004.827072

Schl ̈ogl, A., Lee, F., Bischof, H., & Pfurtscheller, G. (2005, August). Characterization of four-

class motor imagery EEG data for the BCI-competition 2005. Journal of Neural Engineer-

ing, 2 (4), L14–L22. doi: 10/dgb66b

Schwemmer, M. A., Skomrock, N. D., Sederberg, P. B., Ting, J. E., Sharma, G., Bockbrader,

M. A., & Friedenberg, D. A. (2018, November). Meeting brain–computer interface user per-

formance expectations using a deep neural network decoding framework. Nature Medicine,

24 (11), 1669–1676. doi: 10.1038/s41591-018-0171-y

Sellers, E., & Donchin, E. (2006). A P300-based brain–computer interface: Initial tests by ALS

patients. Clinical Neurophysiology. doi: 10.1016/j.clinph.2005.06.027

Sennrich, R., Haddow, B., & Birch, A. (2016, August). Neural Machine Translation of Rare

Words with Subword Units. In Proceedings of the 54th Annual Meeting of the Association

for Computational Linguistics (Volume 1: Long Papers) (pp. 1715–1725). Berlin, Germany:

Association for Computational Linguistics. doi: 10.18653/v1/P16-1162

Serdar Bascil, M., Tesneli, A. Y., & Temurtas, F. (2015, June). Multi-channel EEG signal

feature extraction and pattern recognition on horizontal mental imagination task of 1-

D cursor movement for brain computer interface. Australasian Physical & Engineering

Sciences in Medicine, 38 (2), 229–239. doi: 10/gnbc95

Shakeel, A., Navid, M. S., Anwar, M. N., Mazhar, S., Jochumsen, M., & Niazi, I. K. (2015,

December). A Review of Techniques for Detection of Movement Intention Using Movement-

Related Cortical Potentials. Computational and Mathematical Methods in Medicine, 2015 ,

e346217. doi: 10.1155/2015/346217

Shannon, C. (1949, January). Communication in the Presence of Noise. Proceedings of the IRE ,

37 (1), 10–21. doi: 10/ftzz7r

Sharmila, A., & Geethanjali, P. (2020). DWT Based Time Domain Features on Detection

of Epilepsy Seizures from EEG Signal. In G. Naik (Ed.), Biomedical Signal Processing:

Advances in Theory, Algorithms and Applications (pp. 181–200). Singapore: Springer.

doi: 10.1007/978-981-13-9097-5 9

Shelhamer, E., Long, J., & Darrell, T. (2017). Fully convolutional networks for semantic segmen-

tation. IEEE Transactions on Pattern Analysis and Machine Intelligence, 39 (4), 640–651.

doi: 10.1109/TPAMI.2016.2572683

Shimodaira, H. (2000, October). Improving predictive inference under covariate shift by weight-

ing the log-likelihood function. Journal of Statistical Planning and Inference, 90 (2), 227–

244. doi: 10.1016/S0378-3758(00)00115-4

Shin, J., Kwon, J., & Im, C.-H. (2018). A Ternary Hybrid EEG-NIRS Brain-Computer Inter-

face for the Classification of Brain Activation Patterns during Mental Arithmetic, Motor

Imagery, and Idle State. Frontiers in Neuroinformatics, 12 , 5. doi: 10/ggrkzk

82Shorten, C., & Khoshgoftaar, T. (2019). A survey on Image Data Augmentation for Deep

Learning. Journal of Big Data. doi: 10.1186/s40537-019-0197-0

Shortliffe, E., & Barnett, G. (2006, January). Biomedical Data: Their Acquisition, Storage, and

Use. In Biomedical informatics (pp. 46–79). doi: 10.1007/0-387-36278-9 2

Simonyan, K., & Zisserman, A. (2014). Two-stream convolutional networks for action recognition

in videos. In Z. Ghahramani, M. Welling, C. Cortes, N. Lawrence, & K. Weinberger (Eds.),

Advances in neural information processing systems (Vol. 27). Curran Associates, Inc.

Simonyan, K., & Zisserman, A. (2015). Very Deep Convolutional Networks for Large-Scale Image

Recognition. ICLR.

Singh, S. P. (2014, March). Magnetoencephalography: Basic principles. Annals of Indian

Academy of Neurology, 17 (Suppl 1), S107-S112. doi: 10/gcb3cc

Song, Z., Fang, T., Ma, J., Zhang, Y., Le, S., Zhan, G., . . . Kang, X. (2021, February). Evaluation

and Diagnosis of Brain Diseases based on Non-invasive BCI. In 2021 9th International

Winter Conference on Brain-Computer Interface (BCI) (pp. 1–6). doi: 10.1109/BCI51272

.2021.9385291

Srinivasan, V., Eswaran, C., & Sriraam, N. (2007, May). Approximate Entropy-Based Epilep-

tic EEG Detection Using Artificial Neural Networks. IEEE Transactions on Information

Technology in Biomedicine, 11 (3), 288–295. doi: 10.1109/TITB.2006.884369

Stevenson, I. H., & Kording, K. P. (2011, February). How advances in neural recording affect

data analysis. Nature Neuroscience, 14 (2), 139–142. doi: 10.1038/nn.2731

Steyrl, D., Kobler, R. J., & M ̈uller-Putz, G. R. (2016). On Similarities and Differences of

Invasive and Non-Invasive Electrical Brain Signals in Brain-Computer Interfacing. Journal

of Biomedical Science and Engineering, 09 (08), 393. doi: 10.4236/jbise.2016.98034

Suarjaya, I. M. A. D. (2012, March). A New Algorithm for Data Compression Optimization.

International Journal of Advanced Computer Science and Applications (IJACSA), 3 (8).

doi: 10.14569/IJACSA.2012.030803

Sun, L., Liu, Y., & Beadle, P. (2005, May). Independent component analysis of EEG signals. In

Proceedings of 2005 IEEE International Workshop on VLSI Design and Video Technology,

2005. (pp. 219–222). doi: 10/c8q6qt

Szegedy, C., Liu, W., Jia, Y., Sermanet, P., Reed, S., Anguelov, D., . . . Rabinovich, A. (2015,

June). Going deeper with convolutions. In 2015 IEEE Conference on Computer Vision

and Pattern Recognition (CVPR) (pp. 1–9). doi: 10.1109/CVPR.2015.7298594

Tan, C., Sun, F., Kong, T., Zhang, W., Yang, C., & Liu, C. (2018). A Survey on Deep Transfer

Learning. In V. K ̊urkov ́a, Y. Manolopoulos, B. Hammer, L. Iliadis, & I. Maglogiannis

(Eds.), Artificial Neural Networks and Machine Learning – ICANN 2018 (pp. 270–279).

Cham: Springer International Publishing. doi: 10.1007/978-3-030-01424-7 27

Tangermann, M., M ̈uller, K.-R., Aertsen, A., Birbaumer, N., Braun, C., Brunner, C., . . .

Blankertz, B. (2012). Review of the BCI Competition IV. Frontiers in Neuroscience,

6 , 55. doi: 10/ghhvkk

Tayeb, Z., Fedjaev, J., Ghaboosi, N., Richter, C., Everding, L., Qu, X., . . . Conradt, J. (2019,

January). Validating Deep Neural Networks for Online Decoding of Motor Imagery Move-

ments from EEG Signals. Sensors, 19 (1), 210. doi: 10/ggkz2j

83Thomson, D. (1982, September). Spectrum estimation and harmonic analysis. Proceedings of

the IEEE , 70 (9), 1055–1096. doi: 10.1109/PROC.1982.12433

Townsend, G., LaPallo, B. K., Boulay, C., Krusienski, D., Frye, G. E., Hauser, C. K., . . .

Sellers, E. (2010). A novel P300-based brain–computer interface stimulus presentation

paradigm: Moving beyond rows and columns. Clinical Neurophysiology. doi: 10.1016/

j.clinph.2010.01.030

Turnip, A., & Junaidi, E. (2014, August). Removal artifacts from EEG signal using independent

component analysis and principal component analysis. In 2014 2nd International Confer-

ence on Technology, Informatics, Management, Engineering Environment (pp. 296–302).

doi: 10/gnbc98

Uusitalo, M. A., & Ilmoniemi, R. J. (1997, March). Signal-space projection method for separating

MEG or EEG into components. Medical and Biological Engineering and Computing, 35 (2),

135–140. doi: 10/dd6tm7

van de Laar, B., G ̈urk ̈ok, H., Plass-Oude Bos, D., Poel, M., & Nijholt, A. (2013, June). Experi-

encing BCI Control in a Popular Computer Game. IEEE Transactions on Computational

Intelligence and AI in Games, 5 (2), 176–184. doi: 10.1109/TCIAIG.2013.2253778

van Dokkum, L. E. H., Ward, T., & Laffont, I. (2015, February). Brain computer interfaces for

neurorehabilitation – its current status as a rehabilitation strategy post-stroke. Annals of

Physical and Rehabilitation Medicine, 58 (1), 3–8. doi: 10/gjgt4f

van den Oord, A., Li, Y., & Vinyals, O. (2019, January). Representation Learning with Con-

trastive Predictive Coding. arXiv:1807.03748 [cs, stat] .

Vaswani, A., Shazeer, N., Parmar, N., Uszkoreit, J., Jones, L., Gomez, A. N., . . . Polosukhin, I.

(2017). Attention is All you Need. In Advances in Neural Information Processing Systems

(Vol. 30). Curran Associates, Inc.

Vidal, J. J. (1973). Toward Direct Brain-Computer Communication. Annual Review of Bio-

physics and Bioengineering, 2 (1), 157–180. doi: 10/ffs9t3

Vilela, M., & Hochberg, L. R. (2020). Applications of brain-computer interfaces to the control

of robotic and prosthetic arms. Handbook of Clinical Neurology, 168 , 87–99. doi: 10.1016/

B978-0-444-63934-9.00008-1

Waldert, S. (2016). Invasive vs. Non-Invasive Neuronal Signals for Brain-Machine Interfaces:

Will One Prevail? Frontiers in Neuroscience, 10 .

Wang, F., Jiang, M., Qian, C., Yang, S., Li, C., Zhang, H., . . . Tang, X. (2017, July). Residual

Attention Network for Image Classification. In 2017 IEEE Conference on Computer Vision

and Pattern Recognition (CVPR) (pp. 6450–6458). doi: 10.1109/CVPR.2017.683

Wang, H., Li, Y., Long, J., Yu, T., & Gu, Z. (2014, October). An asynchronous wheelchair

control by hybrid EEG–EOG brain–computer interface. Cognitive Neurodynamics, 8 (5),

399–409. doi: 10/gc6vxq

Wang, Z., Song, Y., & Zhang, C. (2008). Transferred Dimensionality Reduction. In W. Daele-

mans, B. Goethals, & K. Morik (Eds.), Machine Learning and Knowledge Discovery in

Databases (pp. 550–565). Berlin, Heidelberg: Springer. doi: 10.1007/978-3-540-87481-2 36

Wei, J., & Zou, K. (2019). EDA: Easy Data Augmentation Techniques for Boosting Performance

on Text Classification Tasks. EMNLP . doi: 10.18653/v1/D19-1670

84Weisberg, S. (1980). Maximum Likelihood Estimation. In Applied Linear Regression (pp. 309–

312). New York, NY: Wiley.

Welch, P. (1967, June). The use of fast Fourier transform for the estimation of power spectra:

A method based on time averaging over short, modified periodograms. IEEE Transactions

on Audio and Electroacoustics, 15 (2), 70–73. doi: 10/fjndmb

Wermter, S., Riloff, E., & Scheler, G. (Eds.). (1996). Connectionist, statistical, and symbolic

approaches to learning for natural language processing (Vol. 1040). Springer. doi: 10.1007/

3-540-60925-3

Winograd, T. (1971). Procedures as a representation for data in a computer program for under-

standing natural language. M.I.T. Project MAC.

Wolf, T., Debut, L., Sanh, V., Chaumond, J., Delangue, C., Moi, A., . . . Rush, A. M. (2020,

October). Transformers: State-of-the-art natural language processing. In Proceedings of

the 2020 conference on empirical methods in natural language processing: System demon-

strations (pp. 38–45). Online: Association for Computational Linguistics.

Wolpaw, J., Birbaumer, N., Heetderks, W., McFarland, D., Peckham, P., Schalk, G., . . .

Vaughan, T. (2000, June). Brain-computer interface technology: A review of the first

international meeting. IEEE Transactions on Rehabilitation Engineering, 8 (2), 164–173.

doi: 10/dz4238

Wolpaw, J. R., McFarland, D. J., Neat, G. W., & Forneris, C. A. (1991, March). An EEG-

based brain-computer interface for cursor control. Electroencephalography and Clinical

Neurophysiology, 78 (3), 252–259. doi: 10/bj36jg

Wu, P., & Dietterich, T. G. (2004, July). Improving SVM accuracy by training on auxiliary data

sources. In Proceedings of the twenty-first international conference on Machine learning

(p. 110). New York, NY, USA: Association for Computing Machinery. doi: 10.1145/

1015330.1015436

Wyler, A. R. (1987). Electrocorticography. In H. G. Wieser & C. E. Elger (Eds.), Presurgical

Evaluation of Epileptics (pp. 183–191). Berlin, Heidelberg: Springer. doi: 10.1007/978-3

-642-71103-9 31

Xu, G., Shen, X., Chen, S., Zong, Y., Zhang, C., Yue, H., . . . Che, W. (2019). A Deep Transfer

Convolutional Neural Network Framework for EEG Signal Classification. IEEE Access, 7 ,

112767–112776. doi: 10.1109/ACCESS.2019.2930958

Xu, J., Mitra, S., Van Hoof, C., Yazicioglu, R. F., & Makinwa, K. A. A. (2017). Active Elec-

trodes for Wearable EEG Acquisition: Review and Electronics Design Methodology. IEEE

Reviews in Biomedical Engineering, 10 , 187–198. doi: 10.1109/RBME.2017.2656388

Yamins, D., Hong, H., Cadieu, C., Solomon, E., Seibert, D., & DiCarlo, J. (2014). Performance-

optimized hierarchical models predict neural responses in higher visual cortex. Proceedings

of the National Academy of Sciences. doi: 10.1073/pnas.1403112111

Yang, Z., Dai, Z., Yang, Y., Carbonell, J., Salakhutdinov, R., & Le, Q. V. (2019). XLNet:

Generalized Autoregressive Pretraining for Language Understanding. In NeurIPS.

Yger, F., Berar, M., & Lotte, F. (2017, October). Riemannian Approaches in Brain-Computer

Interfaces: A Review. IEEE Transactions on Neural Systems and Rehabilitation Engineer-

ing, 25 (10), 1753–1762. doi: 10.1109/TNSRE.2016.2627016

85Yildiz, K. A., Shin, A. Y., & Kaufman, K. R. (2020, March). Interfaces with the peripheral

nervous system for the control of a neuroprosthetic limb: A review. Journal of NeuroEngi-

neering and Rehabilitation, 17 (1), 43. doi: 10/gh6458

Ying, X. (2019). An Overview of Overfitting and its Solutions. Journal of Physics: Conference

Series. doi: 10.1088/1742-6596/1168/2/022022

Yogatama, D., d’Autume, C. d. M., Connor, J. T., Kocisk ́y, T., Chrzanowski, M., Kong, L., . . .

Blunsom, P. (2019). Learning and Evaluating General Linguistic Intelligence. ArXiv .

Yosinski, J., Clune, J., Nguyen, A., Fuchs, T., & Lipson, H. (2015). Understanding neural

networks through deep visualization. arXiv preprint arXiv:1506.06579 .

Young, C., Liang, S.-F., Chang, D., Liao, Y.-C., Shaw, F., & Hsieh, C.-H. (2011). A Portable

Wireless Online Closed-Loop Seizure Controller in Freely Moving Rats. IEEE Transactions

on Instrumentation and Measurement. doi: 10.1109/TIM.2010.2050358

Zabidi, A., Mansor, W., Lee, Y. K., & Che Wan Fadzal, C. W. N. F. (2012, September). Short-

time Fourier Transform analysis of EEG signal generated during imagined writing. In 2012

International Conference on System Engineering and Technology (ICSET) (pp. 1–4). doi:

10/gnbc92

Zadrozny, B. (2004, July). Learning and evaluating classifiers under sample selection bias. In

Proceedings of the twenty-first international conference on Machine learning (p. 114). New

York, NY, USA: Association for Computing Machinery. doi: 10.1145/1015330.1015425

Zamir, A. R., Sax, A., Shen, W., Guibas, L. J., Malik, J., & Savarese, S. (2018). Taskonomy:

Disentangling Task Transfer Learning. In Proceedings of the IEEE Conference on Computer

Vision and Pattern Recognition (pp. 3712–3722).

Zanini, P., Congedo, M., Jutten, C., Said, S., & Berthoumieu, Y. (2018, May). Transfer Learning:

A Riemannian Geometry Framework With Applications to Brain–Computer Interfaces.

IEEE Transactions on Biomedical Engineering, 65 (5), 1107–1116. doi: 10.1109/TBME

.2017.2742541

Zeiler, M. D., & Fergus, R. (2014). Visualizing and Understanding Convolutional Networks. In

D. Fleet, T. Pajdla, B. Schiele, & T. Tuytelaars (Eds.), Computer Vision – ECCV 2014 (pp.

818–833). Cham: Springer International Publishing. doi: 10.1007/978-3-319-10590-1 53

Zhang, H., Goodfellow, I., Metaxas, D., & Odena, A. (2019, May). Self-Attention Generative

Adversarial Networks. In Proceedings of the 36th International Conference on Machine

Learning (pp. 7354–7363). PMLR.

Zhang, R. (2019). Making Convolutional Networks Shift-Invariant Again. ICML.

Zhang, X., Yao, L., Huang, C., Sheng, Q. Z., & Wang, X. (2017). Intent Recognition in

Smart Living Through Deep Recurrent Neural Networks. In ICONIP. doi: 10.1007/

978-3-319-70096-0 76

Zhang, X., Yao, L., Sheng, Q. Z., Kanhere, S. S., Gu, T., & Zhang, D. (2018, March). Converting

Your Thoughts to Texts: Enabling Brain Typing via Deep Feature Learning of EEG Signals.

In 2018 IEEE International Conference on Pervasive Computing and Communications

(PerCom) (pp. 1–10). doi: 10.1109/PERCOM.2018.8444575

Zhang, X., Yao, L., Zhang, S., Kanhere, S., Sheng, M., & Liu, Y. (2019). Internet of Things Meets

Brain–Computer Interface: A Unified Deep Learning Framework for Enabling Human-

86Thing Cognitive Interactivity. IEEE Internet of Things Journal . doi: 10.1109/JIOT.2018

.2877786

Zhang, Y., Nam, C. S., Zhou, G., Jin, J., Wang, X., & Cichocki, A. (2019, September). Tempo-

rally Constrained Sparse Group Spatial Patterns for Motor Imagery BCI. IEEE Transac-

tions on Cybernetics, 49 (9), 3322–3332. doi: 10.1109/TCYB.2018.2841847

Zhuang, F., Qi, Z., Duan, K., Xi, D., Zhu, Y., Zhu, H., . . . He, Q. (2021, January). A

Comprehensive Survey on Transfer Learning. Proceedings of the IEEE , 109 (1), 43–76. doi:

10.1109/JPROC.2020.3004555

Zoph, B., Ghiasi, G., Lin, T.-Y., Cui, Y., Liu, H., Cubuk, E. D., & Le, Q. (2020). Rethinking

pre-training and self-training. In H. Larochelle, M. Ranzato, R. Hadsell, M. Balcan, &

H. Lin (Eds.), Advances in neural information processing systems (Vol. 33, pp. 3833–3845).

Curran Associates, Inc.